В 1980 году американский философ Джон Сёрл описал мысленный эксперимент, ставший одним из самых известных в современной философии. Его суть в следующем:

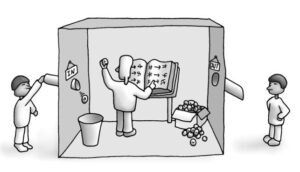

человека, не знакомого с китайским языком, заперли в комнате, содержащей множество табличек с иероглифами. Также имелась книга с инструкцией по использованию этих иероглифов. Люди снаружи? просовывают под дверь другие китайские иероглифы, которые, как неизвестно человеку в комнате, являются вопросами. Следуя книжной инструкции, человек выдавал иероглифы, являющиеся верными ответами на поставленные вопросы. По сути, моделируется компьютерный алгоритм, где коробки с иероглифами стали базой данных, вопросы — программой ввода, ответы — программой вывода, а инструкция есть алгоритм. Таким образом, вопрошающим может казаться, что внутри комнаты находится человек, понимающий китайскую письменность.

Эксперимент показывает, как современные компьютеры создают видимость наличия интеллекта. То есть они не обладают реальным ПОНИМАНИЕМ, создавая лишь видимость понимания, в соответствии с заданными алгоритмами.

Напомню, что интеллект — это способность к познанию и управлению этим познанием на основе памяти, мышления, воображения и восприятия.

В результате эксперимента, научное сообщество сделало три важных вывода:

-

компьютеры могут лишь использовать синтаксические правила для манипулирования символами, но не могут понимать значения и семантику. А следовательно и делать осмысленные выводы.

-

человеческий разум не может быть представлен в виде вычислительной машины или системы обработки информации. Он является результатом биологических процессов.

-

формальные вычисления с символами не могут порождать мысль.

Эти выводы делались последовательно в течение многих лет, но их основу заложил опыт Сёрла. Ему в свою очередь, предшествовал ещё один интересный мысленный эксперимент, в котором множество людей действуют подобно компьютеру. Его автор — советский писатель Анатолий Мицкевич. Он представил, что стадион заполнен 1400 студентами, каждый из которых выполняет двоичные вычисления с цифрами, полученными от соседа. А результаты передаёт следующему соседу. По итогу этой игры, была переведена фраза с португальского языка на русский. Опять же, участники эксперимента действовали по заданному алгоритму, совершенно не осмысляя свою деятельность.

Мы доказали, что даже самая совершенная имитация машинного мышления — это не сам процесс мышления, который является высшей формой движения живой материи. А.Мицкевич

Таким образом, можно сделать вывод о том, что семантику (значение) нельзя получиться из синтаксиса (правил формирования символов). А значение — это и есть ОБРАЗ и СМЫСЛ, который способен ощутить живой разум.

Вы можете возразить, что за 45 лет компьютеры совершили огромный скачок в развитии, и сегодня результаты китайской комнаты не актуальны. Однако создатели языковых моделей для нейросетей чётко заявляют, что программы искусственного интеллекта наделены функциональным, но не осознанным пониманием, а между имитацией понимания и самим пониманием, существует огромная разница.

К примеру, если спросить ChatGPT о том, как он работает и может ли понимать, мы получим вот такой развёрнутый ответ:

ChatGPT работает на статистических вероятностях и нейросетевых алгоритмах, но не формирует намерения, убеждения или личное понимание. Он не может осмысливать или рефлексировать – только прогнозировать вероятностные последовательности текста.

Работает с формальными структурами, а не значением.

ChatGPT предсказывает наиболее вероятные последовательности слов, основываясь на статистике, а не на глубоком понимании концепций.

Он не может осмысливать реальный мир, переживания или субъективные смыслы так, как это делает человек.

Нет самосознания и рефлексии.

У модели нет внутреннего диалога, эмоций или намерений.

Она не задаётся вопросами о своём существовании или значении информации, которую генерирует.

Нет опыта и восприятия реальности.

Несмотря на отсутствие настоящего понимания, ChatGPT убедительно моделирует осмысленный текст, потому что:

Использует контекст и связи между понятиями.

Генерирует ответы, согласованные с предыдущими репликами.

Иногда может строить аргументы и анализировать идеи, что создаёт иллюзию понимания.

Таким образом мы видим, что для компьютерного алгоритма не совсем подходят термины «интеллект» и «разум», так как они относятся к характеристикам живых существ. А то, что мы сейчас называем искусственным интеллектом — это лишь автоматизированный процесс обработки информации. Другое дело, что человек каждый день усложняет алгоритмы нейросетей, наделяя их всё большими возможностями. В конце концов, это может привести к сценарию фильма Терминатор, где напомню, роботы захватили планету. О том, что такой сценарий более чем возможен, говорит недавняя история с известным вирусом, явно не обладающего пониманием, но действующего в соответствии с заданными параметрами.